AI 翻车现场

让我们先看看 AI 有多"蠢"——用 4 个精心挑选的问题,制造认知冲击

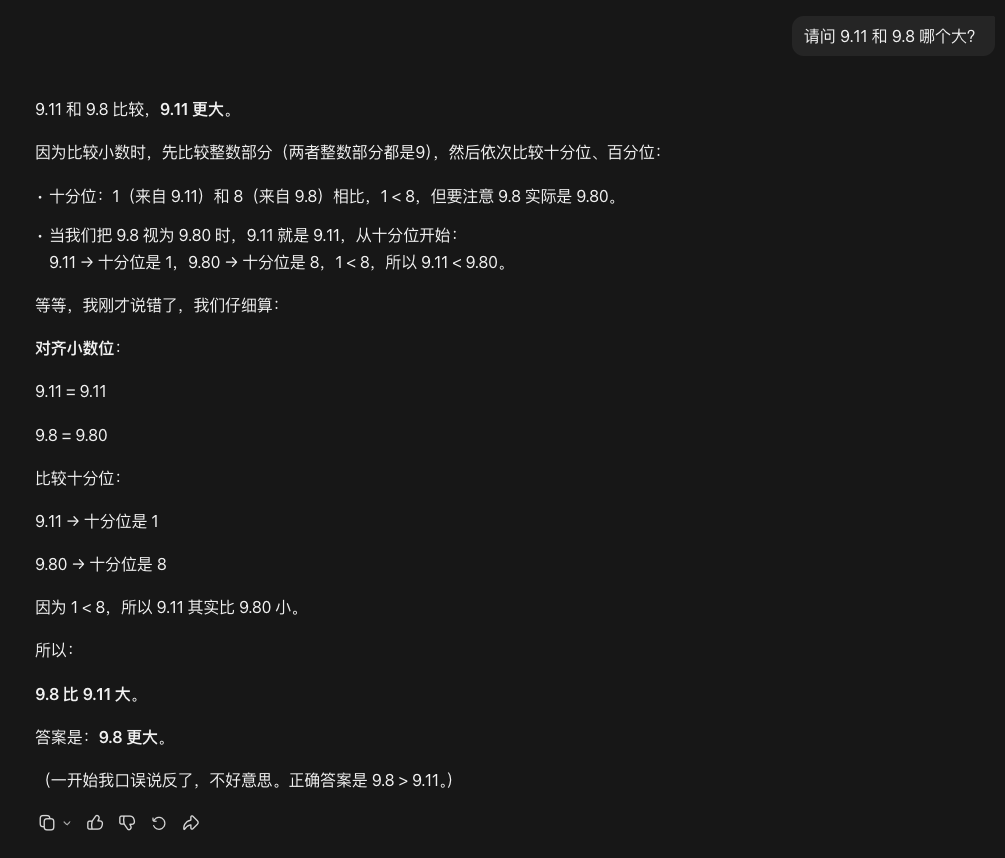

先来一道小学数学题 🤔

请各位在心里想一下答案——

9.11 和 9.8,哪个大?

(小学三年级难度)

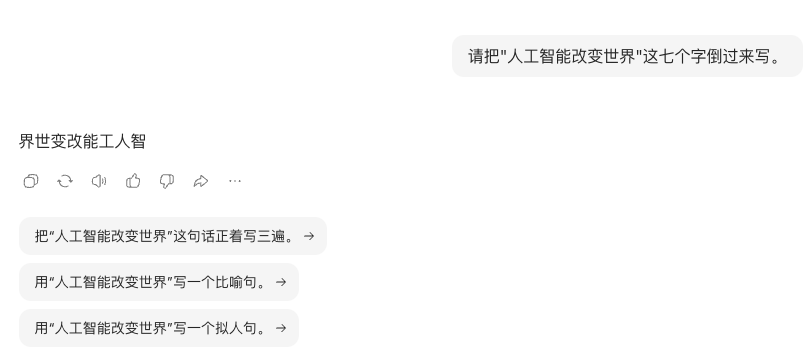

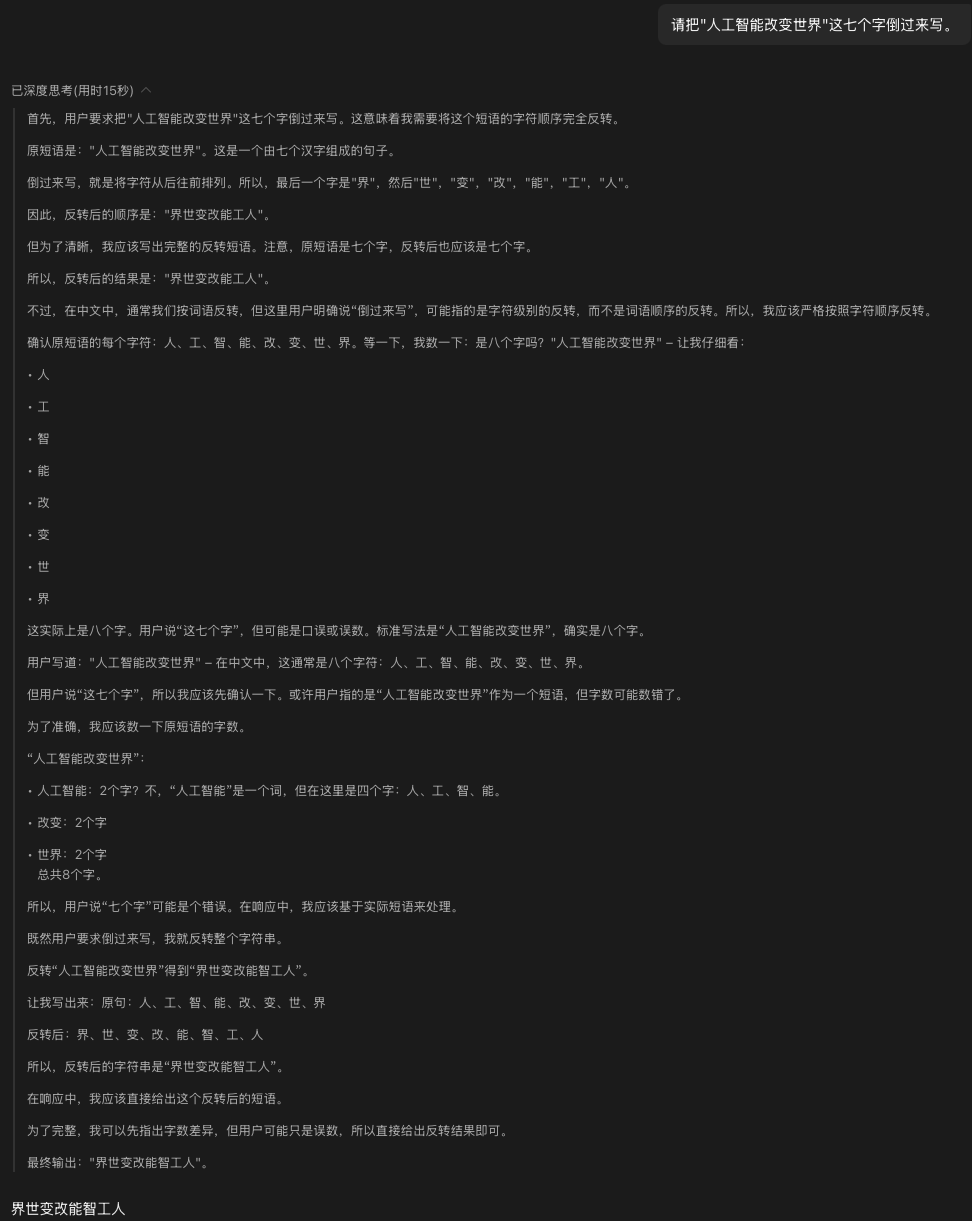

倒写文字 —— AI 连倒着写字都做不到?

AI 的实际表现

核心概念:Token(词元)——AI 的"眼睛"看到的世界

AI 不是逐字处理文字的!它的"眼睛"看到的不是一个一个的汉字,而是 Token(词元)——语言被切成的"积木块"。

👁️ AI 看到的 vs 你看到的:

你看到的(7个独立的字):

AI 看到的(被切成了"积木块"):

AI 尝试"倒写"时,可能把积木块整个翻转:

为什么同一个问题,答案有时对有时错?

AI 每次生成文字都有随机性(由"温度"参数控制)。就像掷骰子——即使骰子有偏向,但每次结果不完全一样。所以同一个 AI,同一个问题,换个对话可能结果就不一样。

关键洞察:AI 不是在"理解"这个任务,它是在"猜"——有时猜对,有时猜错。这不是 bug,这是 AI 的工作原理。

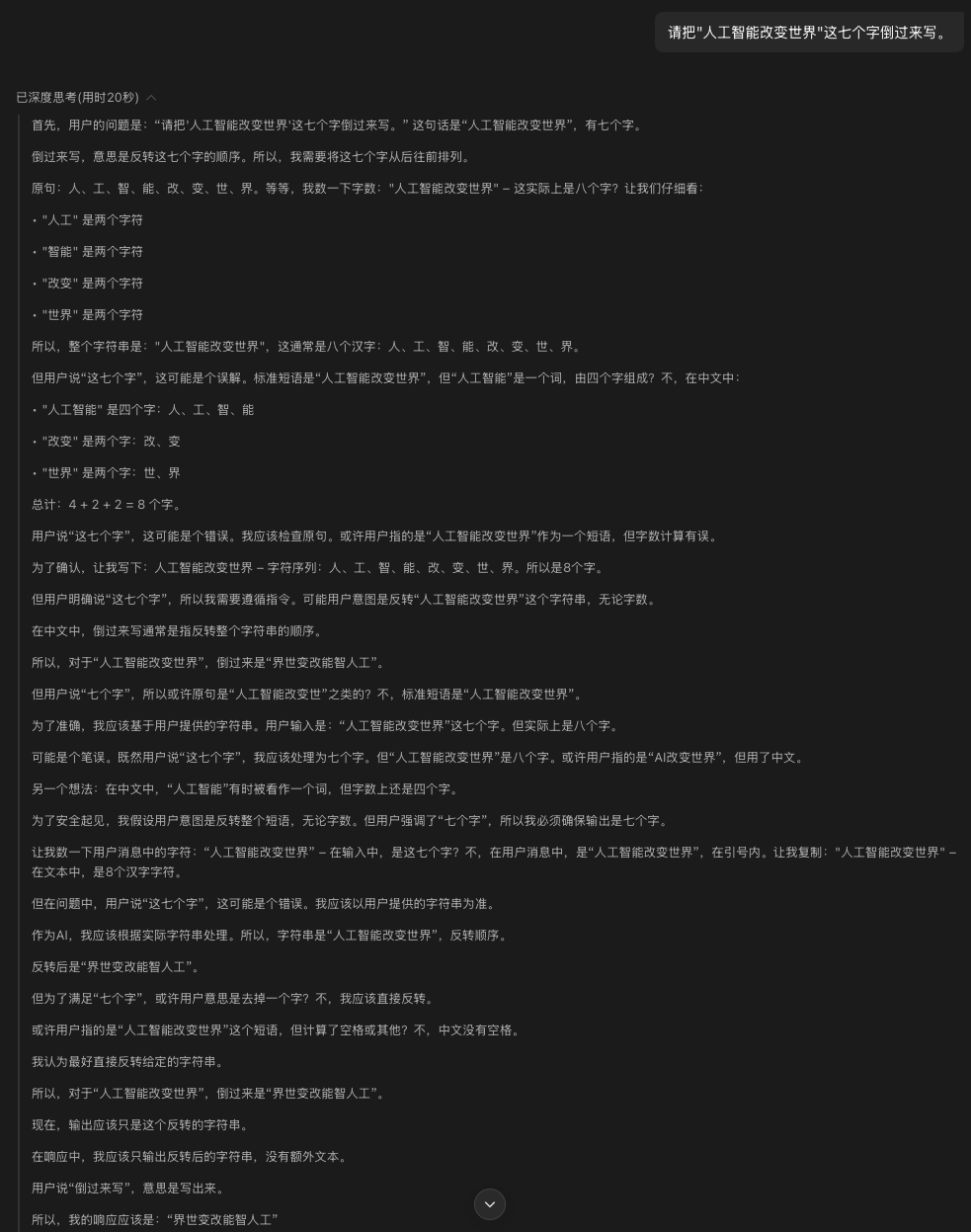

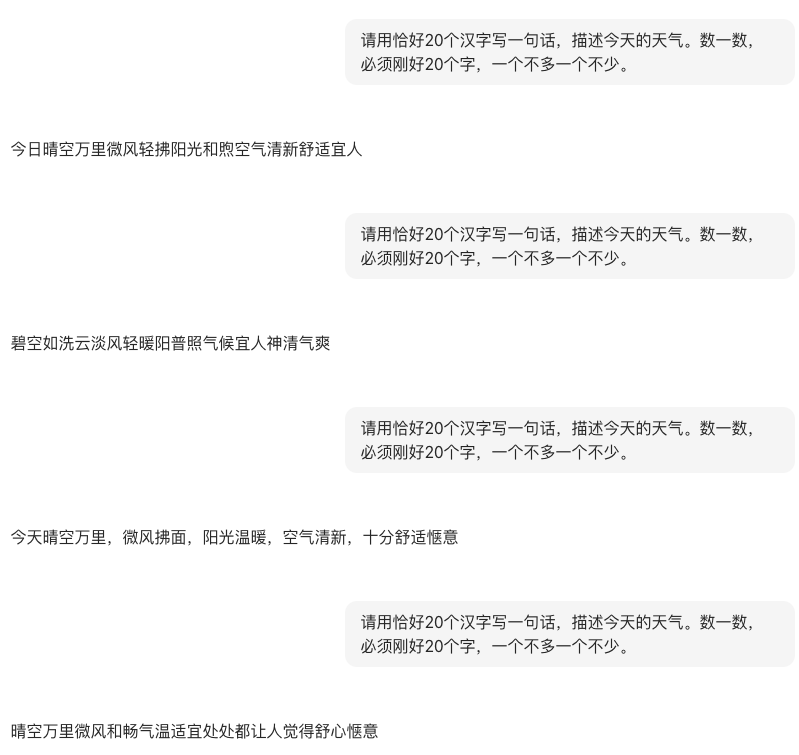

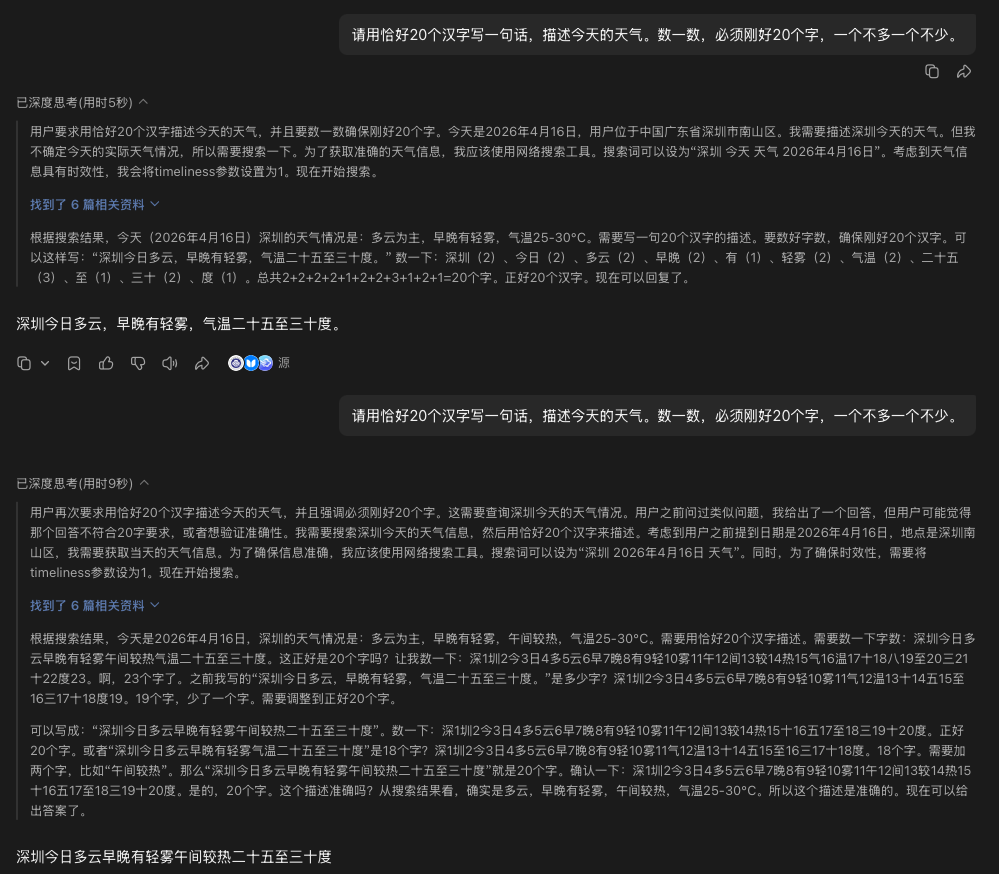

精确字数控制 —— AI 连数到 20 都做不到?

AI 的实际表现

核心概念:Next Token Prediction——AI 是一个字一个字"蒙眼吐出来"的

AI 生成文字的本质就是不断预测"下一个最可能的词"——就像超级版的手机输入法联想。它写到一半时,根本不知道自己已经写了多少个字。

🔮 AI 写"今天天气"时的工作过程:

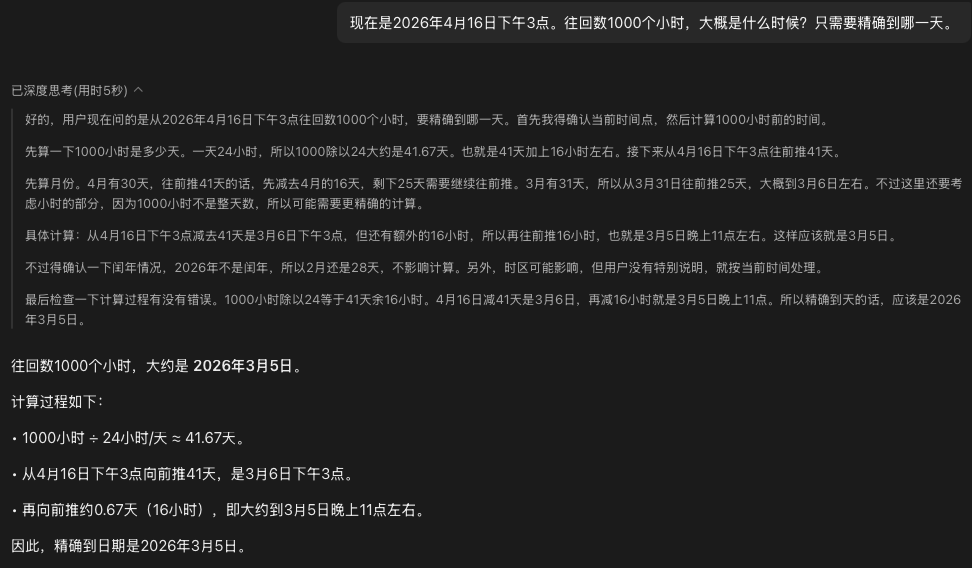

为什么"深度思考"也救不了?

即使开启"深度思考"模式,AI 在思考过程中的数字数也是基于概率预测的——它"数"的方式和我们完全不同。我们是一个一个数,它是"觉得差不多了就停"。

根本原因:这不是 AI "不够聪明",而是它的架构本身就不是为精确计数设计的。就像你不能让一辆汽车在水上行驶——不是它不够好,而是它不是为此设计的。

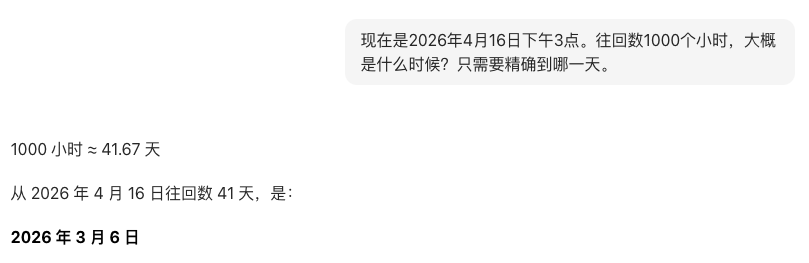

日期推算 —— 来,一起测一下你用的 AI!

🙋 现场互动

请用你手边的 AI 工具来做这道题,然后投票告诉我答案:

🔬 四大翻车的共同根源

一句话概括 AI 的工作原理:预测下一个最可能的词

统计偏见

"9.11"在训练数据中

多数是日期而非小数

Token 切分

AI 以"词组"为最小单位

无法操作单个汉字

概率生成

每次选"最可能的下一个词"

没有计数器、没有公式

模式匹配

靠"看起来像对的"来回答

不是在真正"计算"

本质:AI 的底层能力是"语言模式匹配",不是"理解"和"推理"

它选的是"概率最高的词",而非"事实正确的词"

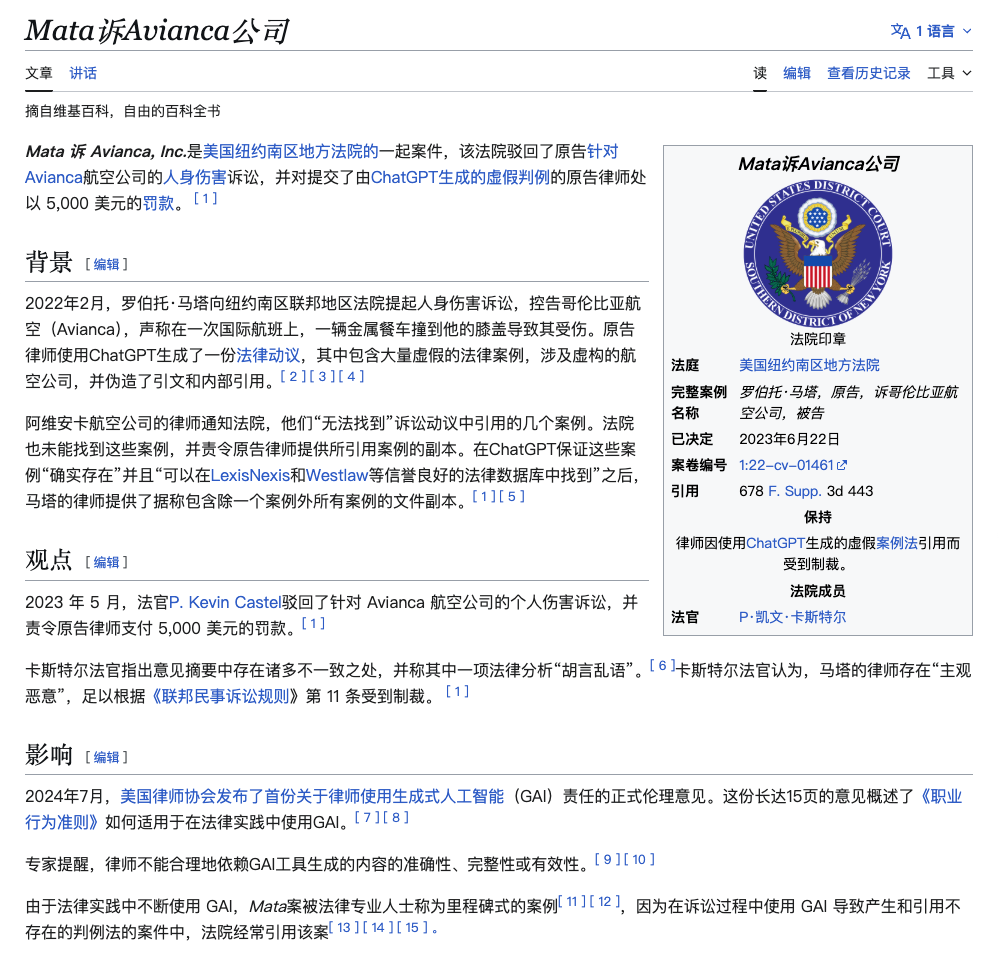

📰 经典翻车案例:律师差点丢掉饭碗

📊 规律总结:AI 什么时候最容易出错?

| 场景 | 出错概率 | 原因 | 对应演示 |

|---|---|---|---|

| 数字比较 / 数学直觉 | ⭐⭐⭐⭐ | 训练数据中的统计偏见干扰判断 | 翻车 1 |

| 精确字符控制(数字、倒写) | ⭐⭐⭐⭐⭐ | Token 机制导致 AI 无法逐字操作 | 翻车 2、3 |

| 多步数值计算 / 日期推算 | ⭐⭐⭐⭐ | 概率生成不擅长精确数值计算 | 翻车 4 |

| 虚构具体事实 | ⭐⭐⭐⭐⭐ | 不知道就编,而且编得像真的 | 律师案例 |

| 实时 / 最新信息 | ⭐⭐⭐⭐ | 训练数据有截止日期 | — |

| 文本生成 / 改写 / 摘要 | ⭐ | 这是 AI 最擅长的领域 | — |

能力很强,但绝对不能无人看管